Innehållsförteckning

Innehållsförteckning- Potentialen hos LLM och grundläggande modeller i leveranskedjan

- Vad är stora språkmodeller (LLM)?

- Fördelar med AI tillämpat på leveranskedjan

- Risker med att tillämpa AI på leveranskedjan

- LLM:s inverkan på teamet för leveranskedjan

- Slutsats: När planeringen förstås börjar den skapa verkligt värde

Översikt

Denna artikel undersöker hur dessa grundläggande AI-tekniker kan tillämpas inom leveranskedjan, från att förenkla åtkomsten till komplexa planeringsplattformar till att stödja prognoser och scenarioanalyser. Den undersöker också fördelarna, riskerna och den praktiska rollen för LLM (Large Language Model) som ett intelligent gränssnitt som hjälper leveranskedjeteam att bättre förstå data, utforska beslut och förbättra den dagliga planeringen.

Att skriva och anpassa texter, hjälpa till att sammanfatta information och generera nya tillvägagångssätt och innovativa idéer – professionellt sett är detta de tre vanligaste förfrågningarna som användare ställer till ChatGPT. Källan är ganska tillförlitlig: OpenAI:s egen plattform.

Utöver dessa ”allmänna” uppgifter har vi nog alla använt dessa uppmaningar någon gång i vårt arbete, men sanningen är att ChatGPT och andra liknande system också kan användas för mer specifika uppgifter. Supply chain är självklart inget undantag. I den här artikeln går vi igenom tillämpningarna av grundläggande AI-system, inklusive stora språkmodeller (LLM) som ChatGPT, inom supply chain.

Vad är stora språkmodeller (LLM)?

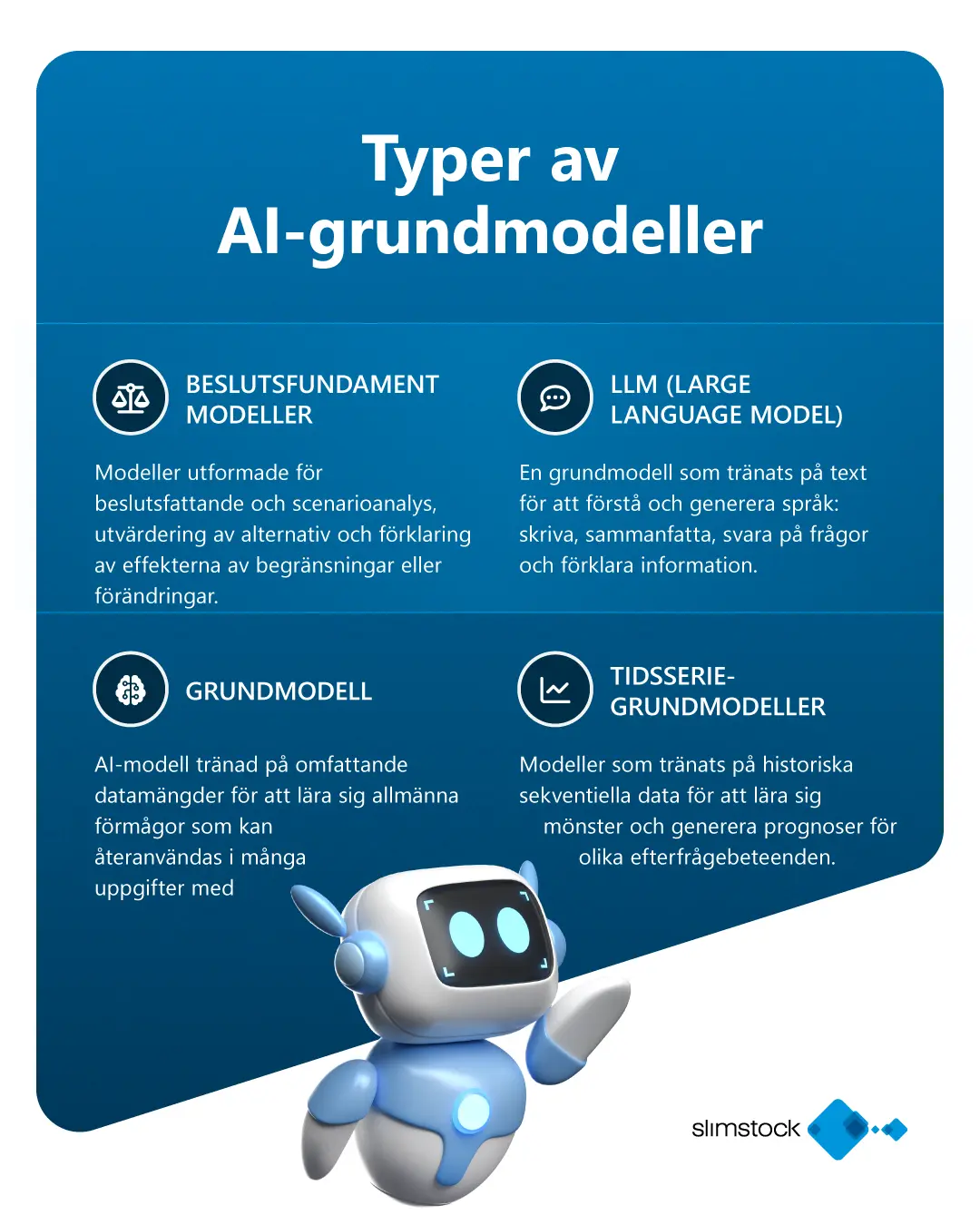

Stora språkmodeller (LLM) är en specifik typ av grundläggande AI-modell. De är tränade med enorma mängder textdata, och deras mål är inte att lösa en enda, specifik uppgift, utan att lära sig en allmän förståelse av språk som kan återanvändas i flera sammanhang.

Tack vare denna träning kan stora språkmodeller (LLM) skriva texter, sammanfatta information, besvara komplexa frågor, dra slutsatser utifrån ostrukturerade data och översätta tekniska begrepp till ett mer lättillgängligt språk. Verktyg som ChatGPT är ett tydligt exempel på detta tillvägagångssätt: en enda modell som kan utföra mycket olika uppgifter utan att behöva omskolas för varje enskild uppgift.

Fördelar med AI tillämpat på leveranskedjan

En LLM är särskilt skicklig på en sak: att arbeta med språk. I leveranskedjan har detta en enorm potential när den kopplas till befintliga system (ERP, WMS, TMS, datalager etc.).

Potentialen hos LLM:er i leveranskedjan ligger inte bara i att be dem att ”optimera”, en uppgift för vilken de, åtminstone för närvarande, inte är tillräckligt effektiva eller tillförlitliga, utan i att hjälpa människor att interagera bättre med befintliga planeringssystem, förstå deras resultat och fatta snabbare och mer välgrundade beslut.

Låt oss titta på några av de viktigaste fördelarna.

Förenkla användningen av komplexa avancerade plattformar

Det har visat sig att avancerad planering sänker kostnaderna, förbättrar servicenivån och håller nere lagernivåerna. Problemet är att värdet av ett optimeringssystem i det dagliga arbetet inte bara beror på att man hittar den bästa lösningen, utan också på att lösningen är begriplig och inger förtroende.

I många företag är det här som klyftan uppstår. Optimeringsplattformen gör sina beräkningar, men de team som använder den är misstänksamma. Detta kan leda till frågor som tar timmar eller dagar att lösa, ett beroende av tekniska experter för relativt enkla frågor och en ständig känsla av: ”Jag vet inte varför systemet har beslutat detta.”

I detta sammanhang börjar LLM:er spela en mycket specifik och användbar roll: de blir ett lager av interaktion och översättning mellan människor och planeringssystem, särskilt när det finns komplexa beslut bakom dem (begränsningar, beroenden, scenarier, prioriteringar etc.).

Inom leveranskedjan finns det frågor som ständigt återkommer:

- ”Varför har vi tillgodosett denna efterfrågan från just denna leverantör (och inte från någon annan)?”

- ”Vad händer om efterfrågan i detta område ökar med 10%?”

- ”Kan vi begränsa antalet leverantörer av kvalitets- eller riskskäl?”

- ”Vilken inverkan skulle det ha att blockera denna transportled?”

- ”Vilken SKU genererar flest skador och varför?”

Dessa vanliga frågor kräver tydliga svar, men för att besvara dem måste man ofta granska parametrar, konsultera tabeller, göra beräkningar, simulera scenarier… Och i många organisationer innebär detta att man måste öppna ett ärende, vänta på en analytiker, konsultera en tekniker, köra om… vilket i slutändan leder till att man förlorar mycket flexibilitet när det gäller att fatta beslut.

Det är här stora språkmodeller (LLM) blir mycket användbara verktyg – inte som ersättning för den matematiska motorn, utan som ett intelligent gränssnitt för att få tillgång till, förklara och utforska dess resultat.

Prognoser för tidsserier

Artificiell intelligens börjar också tillämpas på tidsserieprognoser, även om vi i detta fall tekniskt sett inte talar om LLM utan om så kallade Time Series Foundation Models. Genom att träna på stora mängder historiska data kan de lära sig vanliga mönster och snabbt generera prognoser för en mängd olika beteenden, från intermittent efterfrågan till säsongsmönster eller engångshändelser.

I detta sammanhang är det möjligt att föreställa sig ett scenario där användaren tillhandahåller tidsserier tillsammans med kontextuell information till plattformen, och systemet returnerar en prognos åtföljd av förklaringar, prestationsmått och rekommendationer om hur den kan förbättras. Med denna typ av modell skulle en högkvalitativ prognosprocess kunna uppnås med minimal ansträngning och utan behov av djupgående teknisk kunskap.

Beslutsfattande och hantering av ”tänk om”-scenarier

Återigen avser vi inte strikt LLM:er utan, i detta fall, beslutsgrundsmodeller. Denna typ av AI kan gå utöver tidsserieprognoser och även tillämpas på beslutsproblem. Tack vare denna tidigare träning kan modellen hantera olika typer av beslut med minimal justering.

I detta sammanhang, när användaren ställer en ”tänk om”-fråga, tolkar LLM-modellen avsikten (t.ex. ”blockera denna leverantör” eller ”begränsa denna anläggning”) och startar scenariot. Den jämför sedan resultatet med den aktuella planen och förklarar det.

Den största fördelen är att det inte finns något behov av avancerad matematik: för företag är svaret vanligtvis ”öka/minska kostnaden”, ”tjänsten äventyras”, ”en risk uppstår”, ”belastningen förskjuts” eller ”det finns ingen genomförbar lösning”.

Att göra befintlig (men splittrad) information tillgänglig

En del av problemet är att data i leveranskedjan finns i silor: tabeller, rapporter, instrumentpaneler, olika verktyg, olika nomenklaturer… och frågor kräver ofta korsreferenser mellan flera källor. En LLM kan fungera som en ”orkestrerare” av frågor: inte för att den ”känner till” data, utan för att den kan begära den från rätt system och sammanställa ett sammanhängande svar.

Risker med att tillämpa AI på leveranskedjan

Om du tillämpar LLM på din leveranskedja finns det två oundvikliga problem:

Sekretess och känsliga data

Det mest förnuftiga tillvägagångssättet är att inte dumpa data i modellen. Istället fungerar LLM som ett lager av resonemang och språk, medan data och beräkningar förblir inom din miljö (databaser, lösare, interna system).

”Hallucinationer” och svar som låter trovärdiga

I leveranskedjan är ett felaktigt svar inte bara ett anekdotiskt misslyckande: det kan kosta pengar, service och/eller varumärkets rykte.

Därför är den mest rekommenderade tillvägagångssättet inte ”fråga LLM och lita på svaret”, utan snarare:

- LLM föreslår åtgärden (fråga, scenario, begränsning).

- Systemet validerar den (regler, behörigheter, kontroller).

- Plattformen för hantering av leveranskedjan beräknar det.

- LLM förklarar resultatet.

LLM:s inverkan på teamet för leveranskedjan

När det gäller den operativa påverkan innebär en väl utformad strategi med ”LLM som planeringsco-pilot” vanligtvis:

- Större självständighet för planeraren att utforska scenarier utan att behöva förlita sig på teknik eller analys.

- Mindre intern friktion: mindre fram- och tillbaka för att förklara ”varför”.

- Snabbare beslut när förändringar inträffar (efterfrågan, kapacitet, leverantörer, transport).

- Bättre acceptans av planeringssystemet: om det förstås, används det; om det används, skapar det värde.

Slutsats: När planeringen förstås börjar den skapa verkligt värde

I leveranskedjan är en av de största utmaningarna, utöver att beräkna svaret på ett problem, att omvandla det svaret till ett beslut som företaget förstår, litar på och genomför.

Ur detta perspektiv ligger värdet av LLM inte i att ”göra planen” eller ersätta plattformar för optimering av leveranskedjan, utan i att föra avancerad planering närmare de människor som fattar beslut varje dag. Genom att fungera som ett lager av tolkning och dialog gör de det möjligt att utforska scenarier, förstå orsakerna bakom varje förslag och minska friktionen mellan komplexa modeller och den operativa verkligheten.

Om nästa mognadsnivå i leveranskedjan innebär att överbrygga klyftan mellan vad systemet beräknar och vad företaget behöver besluta, framstår LLM:er – ansvarsfullt integrerade och kopplade till robusta planeringsverktyg – som en viktig faktor för att uppnå detta.